3 Strategien zur Abwehr von KI-Phishing in Unternehmen

Die Angst vor einem Cyberangriff ist weltweit groß. Denn nicht nur Unternehmen sind von Angriffen betroffen, auch Staaten und Privatpersonen geraten immer wieder ins Visier von Cyberkriminellen.

Wie sehr sich Cyberbetrug weiterentwickelt hat, zeigt sich eindrucksvoll am Beispiel des berüchtigten „Nigerian Prince Scam“. Diese Art des Vorschussbetrugs, die einst mit holprigem Englisch, unpersonalisierten Nachrichten und offensichtlichen Rechtschreibfehlern begann, hat sich durch künstliche Intelligenz (KI) zu einer existenzbedrohenden Gefahr für Unternehmen entwickelt.

Die steigende Gefahr durch KI-gestütztes Phishing

Die aktuelle Bitkom-Studie „Wirtschaftsschutz 2024“ belegt, dass 26 Prozent aller deutschen Unternehmen in den letzten zwölf Monaten von ausgefeilten Angriffen betroffen waren. Der Schaden durch Cyberangriffe auf deutsche Unternehmen erreichte mit 267 Milliarden Euro einen historischen Höchstwert. Besonders betroffen sind der IT-Sektor sowie Forschungs- und Bildungseinrichtungen.

Ein weiteres Alarmsignal: Die Anzahl der Angriffsversuche steigt jedes Jahr. 78 Prozent der deutschen Unternehmen gaben an, bereits einmal angegriffen worden zu sein. Dennoch schulen lediglich 21 Prozent ihre Mitarbeitenden im Bereich Cyberkriminalität. Gleichzeitig lag Deutschland 2023 mit 57 Millionen versuchten Phishing-Angriffen weltweit auf Platz fünf.

Schützen Sie Ihr Unternehmen

Schützen Sie Ihr Unternehmen

Wir denken Sicherheit ganzheitlich und beraten Sie gern zu geeigneten Maßnahmen für Ihre KI-Anwendungen.

Schutzmaßnahmen entdeckenWie KI das Angriffsverhalten verändert

Cyberangreifer verfügen über eine nie dagewesene Menge an Tools, die ihnen das Planen und Durchführen von Angriffen erleichtern. Diese Werkzeuge verschärfen die Bedrohungslage erheblich, da sie die Qualität und Menge von Phishing-Angriffen massiv erhöhen können. Besonders bedrohlich: KI-gestützte Technologien wie generative KI und Deepfakes, die Angriffe realistischer und schwerer zu erkennen machen.

Was bedeutet die KI-Technologie für das Thema Phishing?

Die Verfügbarkeit von KI-Tools senkt die Eintrittsbarriere für Cyberkriminelle drastisch. Selbst unerfahrene Angreifer können mittlerweile effektive Phishing-Kampagnen starten. Kleine und mittelständische Unternehmen (KMUs) sind besonders betroffen, da sie oft nur unzureichende Schutzmaßnahmen besitzen.

Niedrige Hürde für Phishing

Ein grundlegendes Problem durch die Verfügbarkeit von KI-Tools ist die niedrige Hürde, die Cyberkriminellen dadurch geboten wird. Angreifer benötigen weniger technische Fähigkeiten und Know-how, um effektives Phishing zu betreiben. Das führt zu einer größeren Verbreitung von Angriffen, auch durch unerfahrene Cyberkriminelle, und zu einer Verlagerung von Angriffen auf kleine und mittelständische Unternehmen, die häufig nur unzureichende Schutzmaßnahmen eingerichtet haben.

Mehr Authentizität im Social Engineering

Angreifer setzen nicht nur auf verfügbare Tools, sondern nutzen auch gezielt Social Engineering, um ihre Ziele zu erreichen. Dabei rückt der Mensch zunehmend in den Fokus von Cyberkriminellen. Im Moment eines Angriffs liegt es häufig in der Verantwortung des Einzelnen, zu beurteilen, ob es sich um einen Angriff handelt oder nicht, wie auch die Chancen und Risiken von Social Engineering verdeutlichen.

Die Nutzung von künstlicher Intelligenz erschwert diese Entscheidung zusätzlich, da maschinell generierte Inhalte mittlerweile so authentisch wirken, dass sie kaum noch von menschlich erstellten Nachrichten zu unterscheiden sind. Durch generative KI-Modelle, die menschliche Emotionen verstehen und verarbeiten, werden Nachrichten generiert, die bei den Empfänger*innen gezielt Emotionen auslösen, indem diese bspw. Vertrauen aufbauen oder Druck erzeugen.

Einsatz generativer KI zur Erstellung von Phishing-Mails

Der Einsatz von generativer KI ermöglicht es Cyberkriminellen, täuschend echte Phishing-Mails und Nachrichten in großer Menge zu erstellen. Ließen sich Phishing-Versuche zuvor aufgrund fehlerhafter Satzstruktur, Rechtschreibfehlern oder falsch verwendeter Wörter schnell als solche enttarnen, fällt dies aufgrund des Einsatzes von KI immer schwerer.

Künstliche Intelligenz lernt immer weiter dazu und ist in der Lage, Daten über Unternehmen und Privatpersonen zu analysieren. Im Falle von Unternehmen kann die KI den exakten Kommunikationsstil imitieren.

Gefahr durch Deepfakes

Neben den bereits erwähnten Phishing-Mails können auch realistisch wirkende Videos und Audiodateien erstellt werden, wie der Fall eines Unternehmens in Hongkong zeigt. Dieses Beispiel zeigt beeindruckend, dass es für KI-Angriffe kaum noch Grenzen gibt. Ein Finanzmitarbeiter bekam eine E-Mail des CFO aus Großbritannien, die er ursprünglich als Phishing-Mail einschätzte, da der Mitarbeiter in der Mail dazu aufgefordert wurde, eine geheime Transaktion zu tätigen.

Jedoch folgte der Mail ein Videoanruf, an dem mehrere Kollegen teilnahmen, die dem Finanzmitarbeiter bekannt waren und die sowohl so aussahen, als sich auch anhörten, wie seine tatsächlichen Kollegen. Dadurch in der Authentizität der Anfrage bestätigt, wies der Finanzmitarbeiter die 25,6 Millionen Dollar zur Überweisung an und fiel so auf den Deepfake-Angriff herein.

Probleme in der Erkennung durch Sicherheitsmaßnahmen

Durch den Einsatz von generativer KI können Cyberangreifer die Sicherheitsmaßnahmen von Unternehmen umgehen. Generative KI kann einzigartige Nachrichten erzeugen und somit dynamische Inhalte bieten, die durch Mustererkennungssoftware schwerer identifiziert werden können. Zusätzlich wirken Phishing-Inhalte durch KI natürlicher und unauffälliger, wodurch herkömmliche Spamfilter weniger effektiv werden.

3 effektive Strategien zur Abwehr von KI-Phishing

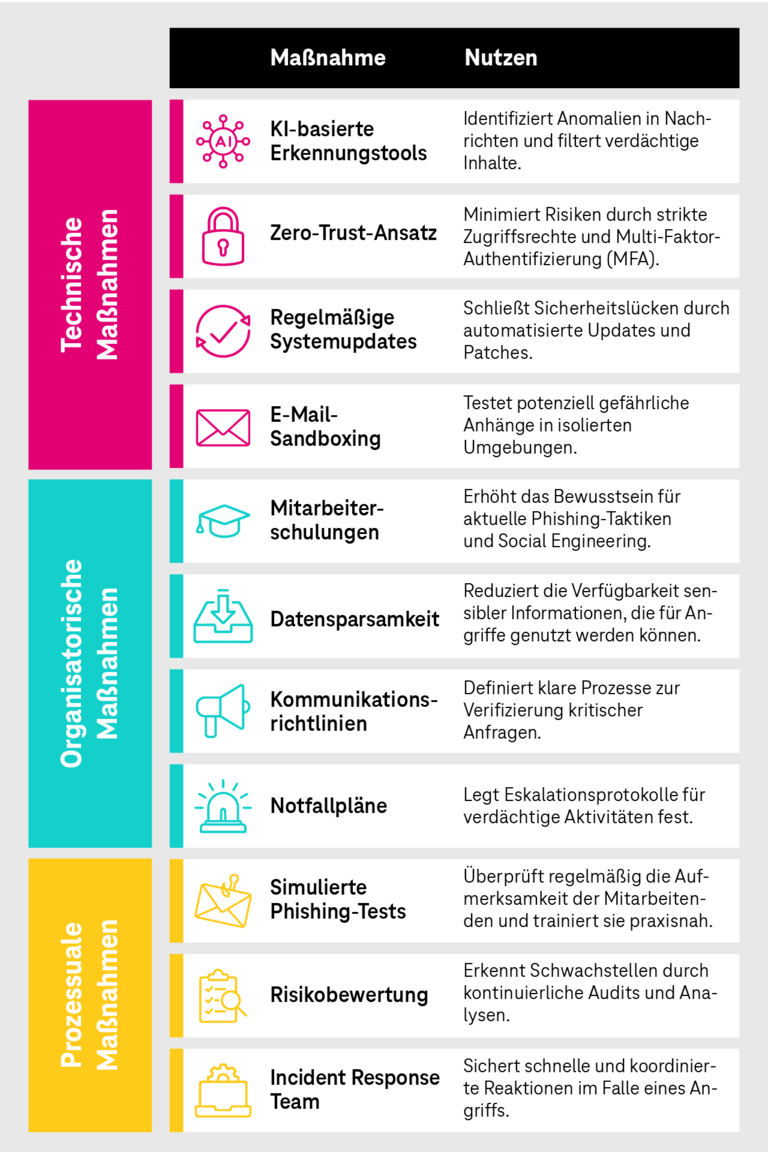

Die Bedrohung durch KI-Phishing und Deepfakes erfordert umfassende Maßnahmen, wie etwa die Einführung technischer Schutzmechanismen. Diese lassen sich in drei Kategorien einteilen: technische, organisatorische und prozessuale Maßnahmen.

1. Technische Maßnahmen: Aufbau automatisierter Verteidigungslinien

- KI-basierte Erkennungstools: Nutzen Sie spezialisierte Tools, die Anomalien in Nachrichten erkennen können. Beispiele sind speziaisierte Spamfilter oder Systeme zur Verhaltensanalyse.

- Zero-Trust-Ansatz: Implementieren Sie Multi-Faktor-Authentifizierung (MFA) und strikte Zugriffsrechte, um das Risiko zu minimieren.

- Regelmäßige Systemupdates: Automatisieren Sie Updates, um bekannte Sicherheitslücken schnell zu schließen.

- E-Mail-Sandboxing: Testen Sie potenziell gefährliche Anhänge in isolierten Umgebungen.

2. Organisatorische Maßnahmen: Sicherheitskultur fördern

- Mitarbeiterschulungen: Führen Sie regelmäßig Trainings durch, um das Bewusstsein für aktuelle Phishing-Taktiken und Social Engineering zu stärken.

- Datensparsamkeit: Vermeiden Sie, dass sensible Informationen öffentlich zugänglich sind. Dies erschwert es Angreifern, relevante Daten für Angriffe zu sammeln.

- Kommunikationsrichtlinen: Definieren Sie klare Prozesse zur Überprüfung kritischer Anfragen, z. B. durch Rückfragen oder separate Kommunikationskanäle.

- Notfallpläne: Erstellen Sie Eskalationsprotokolle, die im Falle eines Angriffs eingehalten werden können.

3. Prozessuale Maßnahmen: Strukturen für konsistentes Handeln

- Simulierte Phishing-Tests: Überprüfen Sie regelmäßig die Aufmerksamkeit der Mitarbeitenden. Diese Tests sollten je nach Erfahrungsstand angepasst werden.

- Risikobewertung: Setzen Sie auf kontinuierliche Schwachstellenanalysen und Audits, um Sicherheitslücken zu erkennen und zu beheben.

- Incident Response Team: Bilden Sie ein Team, das im Ernstfall schnell und koordiniert auf Angriffe reagieren kann.

Übersicht: Maßnahmen gegen KI-Phishing

Sind Ihre Schutzmechanismen bereit für die KI-Herausforderung?

Ein Manager bei Ferrari wurde Ziel eines Audio-Deepfake-Angriffs, bei dem die Stimme des CEOs nachgeahmt wurde, um eine geheime Zahlung zu veranlassen. Nur dank gezielter Rückfragen konnte der Betrug rechtzeitig erkannt werden. Nicht immer geht es so glimpflich aus. Zwei Mitarbeitende einer französischen Produktionsfirma erhielten scheinbar glaubwürdige Anweisungen ihres Chefs. Sie bemerkten nicht, dass es sich um einen Betrug handelte, und überwiesen 21 Millionen Dollar. Der Vorfall führte nicht nur zu einem enormen finanziellen Verlust, sondern auch zum Verlust der Arbeitsplätze der beiden Mitarbeitenden.

Die genannten Beispiele von CEO-Frauds verdeutlichen die Gefahren von KI-Phishing und Deepfakes. Unternehmen sollten nicht nur technische Schutzmaßnahmen ergreifen, sondern auch regelmäßig Mitarbeitende schulen und klare Prozesse etablieren. Unser Digital Trust Team hilft Ihnen, sich gegen diese Herausforderungen zu wappnen – mit einem ganzheitlichen Ansatz, der Menschen, Technik und Prozesse verbindet.

Weitere Informationen

- Wir zeigen Sicherheitsrisiken beim KI-Einsatz und wie Sie Ihnen bestmöglich begegnen. Erfahren Sie mehr über KI-Sicherheit: Schutzmaßnahmen & Abwehrmechanismen.

- Sie möchten eine KI-Lösung im Unternehmen einsetzen? Unsere Experten erklären im Podcast, wie Sie KI mit echtem Mehrwert implementieren.